به گزارش تجارت نیوز، یک مطالعه جدید به ادعاهای مطرحشده در مورد استفاده OpenAI از محتوای دارای حق کپی برای آموزش برخی از مدلهای هوش مصنوعی خود اعتبار میبخشد. OpenAI در حال حاضر با شکایات متعدد از سوی نویسندگان، برنامهنویسان و سایر صاحبان حقوقی مواجه است که این شرکت را متهم به استفاده از آثار آنها، از جمله کتابها و کدها برای توسعه مدلهای خود بدون اجازه میکنند. در حالی که OpenAI به مدت طولانی از دفاع «استفاده عادلانه» استفاده کرده است، شاکیان در این موارد استدلال میکنند که قانون حق کپی ایالات متحده هیچ استثنایی برای دادههای آموزشی ندارد.

روش تحقیق

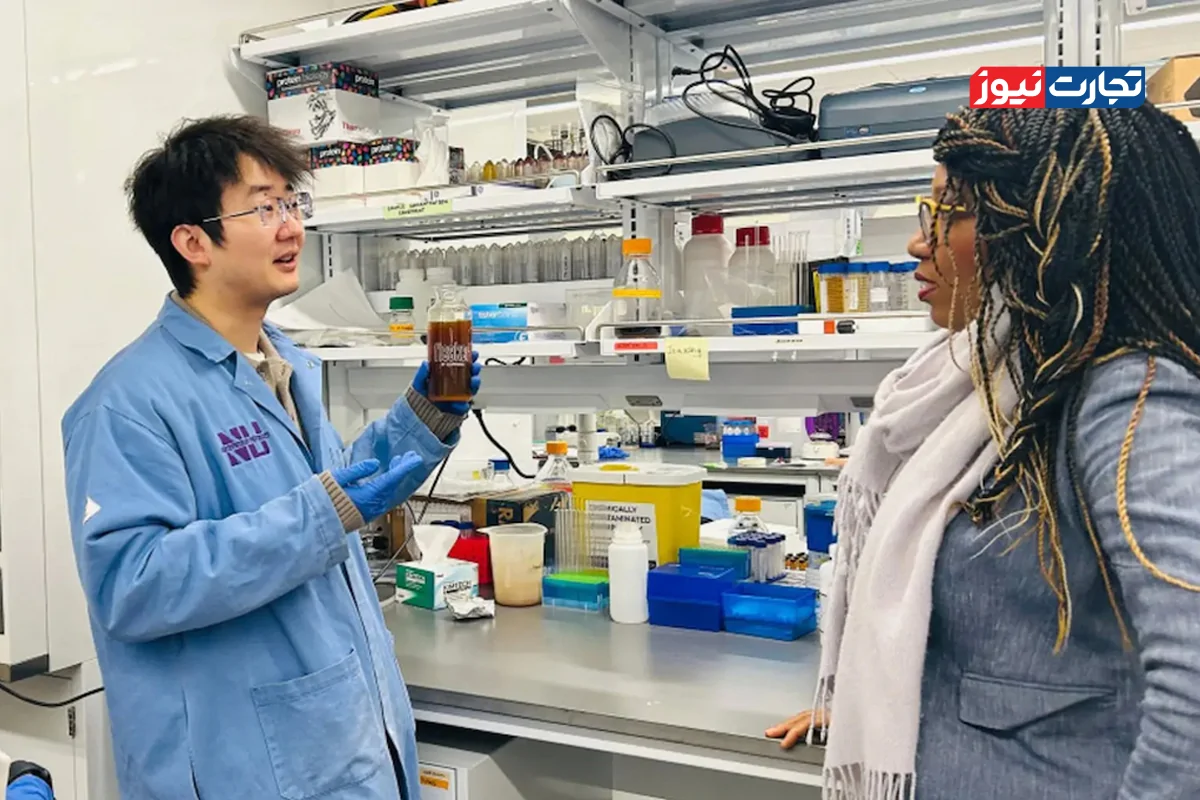

این مطالعه که بهطور مشترک توسط محققانی از دانشگاه واشنگتن، دانشگاه کپنهاگ و دانشگاه استنفورد نوشته شده، روش جدیدی برای شناسایی دادههای آموزشی «به خاطر سپرده شده» توسط مدلهای پشت API، مانند مدلهای OpenAI، ارائه میدهد. مدلها در واقع موتورهای پیشبینی هستند. آنها با آموزش بر روی حجم زیادی از دادهها الگوها را یاد میگیرند و به همین دلیل میتوانند مقالات، عکسها و موارد دیگر را تولید کنند. بیشتر خروجیها کپیهای دقیق از دادههای آموزشی نیستند، اما به دلیل نحوه یادگیری مدلها، برخی از آنها بهطور ناگزیر چنین هستند. بهعنوان مثال، مدلهای تصویری بهطور مکرر اسکرینشاتهایی از فیلمهایی که بر روی آنها آموزش دیدهاند را بازتولید کردهاند، در حالی که مدلهای زبانی نیز بهطور مؤثر مقالات خبری را سرقت ادبی کردهاند.

کلمات غیرمعمول

روش مطالعه به کلماتی که نویسندگان آنها را «کلمات با شگفتی بالا» مینامند، متکی است؛ به این معنا که این کلمات در زمینه یک مجموعه بزرگتر از آثار غیرمعمول به نظر میرسند. بهعنوان مثال، کلمه «رادار» در جمله «جک و من بهطرز کاملاً ساکت در کنار رادار نشسته بودیم» بهعنوان یک کلمه با شگفتی بالا در نظر گرفته میشود زیرا احتمال وقوع آن در مقایسه با کلماتی مانند «موتور» یا «رادیو» قبل از «هام» کمتر است.

نتایج آزمونها

نویسندگان این مطالعه چندین مدل OpenAI، از جمله GPT-4 و GPT-3.5 را برای نشانههای به خاطر سپردن مورد بررسی قرار دادند. آنها با حذف کلمات با شگفتی بالا از بخشهایی از کتابهای داستانی و مقالات نیویورک تایمز، از مدلها خواستند تا «حدس بزنند» کدام کلمات مخفی شدهاند. اگر مدلها توانستند بهدرستی حدس بزنند، بهاحتمال زیاد آنها در طول آموزش، این بخش را به خاطر سپردهاند.

شواهد از حافظه مدلها

براساس نتایج آزمونها، GPT-4 نشانههایی از به خاطر سپردن بخشهایی از کتابهای داستانی محبوب نشان داد که شامل کتابهایی از یک مجموعه داده حاوی نمونههای کتابهای الکترونیکی دارای حق کپی به نام BookMIA بود. نتایج همچنین نشان داد که این مدل بخشهایی از مقالات نیویورک تایمز را نیز به خاطر سپرده است، هرچند با نرخ کمتر.

نیاز به شفافیت داده

ابهیلاشا راویچاندر، دانشجوی دکتری دانشگاه واشنگتن و یکی از نویسندگان این مطالعه، اذعان کرد که یافتهها بر «دادههای جنجالی» که مدلها ممکن است بر اساس آن آموزش دیده باشند، نور میافکند. او گفت: «برای داشتن مدلهای زبانی بزرگ که قابل اعتماد باشند، باید مدلهایی داشته باشیم که بتوانیم آنها را مورد بررسی و ممیزی علمی قرار دهیم. کار ما هدف دارد ابزاری برای بررسی مدلهای بزرگ زبانی فراهم کند، اما نیاز واقعی به شفافیت بیشتر دادهها در سراسر اکوسیستم وجود دارد.»

OpenAI به مدت طولانی خواستار کاهش محدودیتها در توسعه مدلها با استفاده از دادههای دارای حق کپی بوده است. در حالی که این شرکت قراردادهای مجوز محتوای خاصی دارد و مکانیزمهای خروجی را ارائه میدهد که به صاحبان حق کپی اجازه میدهد محتوایی را که دوست ندارند شرکت از آن برای اهداف آموزشی استفاده کند، پرچمگذاری کنند، این شرکت همچنین بهدنبال تصویب قوانین «استفاده عادلانه» در مورد رویکردهای آموزش هوش مصنوعی در چندین دولت بوده است.