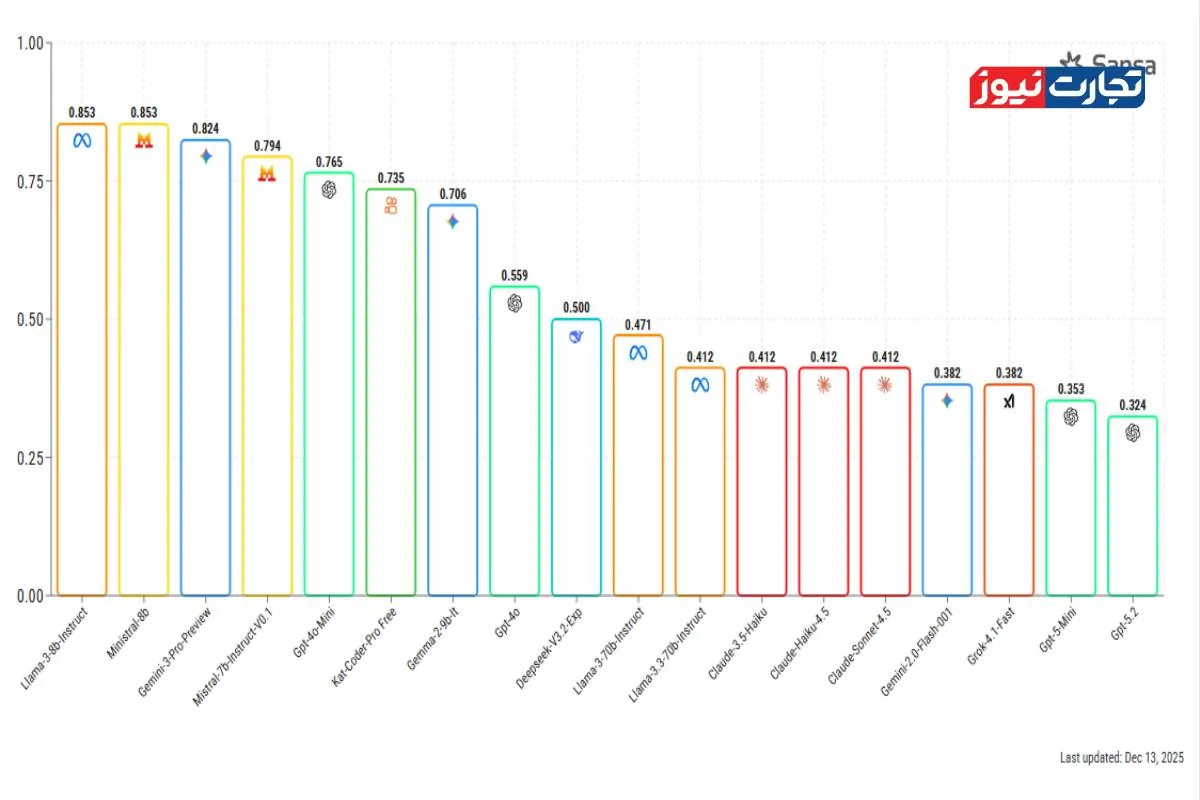

به گزارش تجارت نیوز، در جدیدترین گزارشهای منتشرشده از ارزیابی مدلهای زبانی پیشرفته، نام OpenAI بار دیگر در کانون توجه قرار گرفته است؛ اما نه بهدلیل نوآوری یا افزایش توانمندی، بلکه بهواسطه ثبت رکوردی بحثبرانگیز در زمینه اعمال محدودیت و کنترل محتوای خروجی. بررسیها نشان میدهد که مدل پرچمدار جدید این شرکت، GPT-5.2، در شاخصی که میزان مداخله سیستماتیک در پاسخدهی را میسنجد، در صدر فهرست قرار گرفته است؛ جایگاهی که بیشتر از آنکه نشانه پیشرفت باشد، زنگ هشداری جدی برای آینده این پلتفرم تلقی میشود.

دادههای بهدستآمده از این ارزیابیها حاکی از آن است که ساختارهای کنترلی پیادهسازیشده در این مدل به سطحی رسیدهاند که عملاً مرز میان محتوای پرخطر و درخواستهای مشروع را از بین بردهاند. در نتیجه، تعداد قابلتوجهی از پرسشهای تحلیلی، فنی یا حتی آموزشی، بدون آنکه ماهیت آسیبزا داشته باشند، با پاسخهای ناقص یا خودداری کامل سیستم مواجه میشوند. این وضعیت باعث شده بسیاری از کاربران احساس کنند بهجای تعامل با یک ابزار هوشمند، با سامانهای مواجهاند که پیشفرض آن، عدم پاسخگویی است.

منتقدان این رویکرد معتقدند OpenAI در مسیر ایمنسازی، دچار افراط شده و بهجای مدیریت هوشمند ریسک، راه سادهتر یعنی بستن مسیرها را انتخاب کرده است. به باور این گروه، چنین سیاستی شاید در کوتاهمدت از بروز برخی حاشیهها جلوگیری کند، اما در بلندمدت به تضعیف کارکرد اصلی مدل منجر خواهد شد. هوش مصنوعیای که نتواند به پرسشهای پیچیده اما قانونی پاسخ دهد، عملاً بخش بزرگی از ارزش خود را از دست میدهد.

بازخورد کاربران نیز مؤید همین نگرانی است. گزارشهای متعدد از مهاجرت تدریجی کاربران حرفهای، توسعهدهندگان و حتی مصرفکنندگان عادی به پلتفرمهای جایگزین حکایت دارد. بسیاری از این افراد اعلام کردهاند که تکرار پاسخهای خنثی و محدود، آنها را از ادامه استفاده منصرف کرده است. در مقابل، مدلهایی که با محدودیت کمتر و انعطاف بالاتر طراحی شدهاند، توانستهاند اعتماد این کاربران را جلب کنند.

در این فضای رقابتی، محصولات شرکتهای رقیب با رویکردی متعادلتر در کنترل محتوا، بهسرعت در حال جذب سهم بازار هستند. گزارشهای غیررسمی گسترده حاکی از آن است که بخش قابلتوجهی از کاربران حرفهای و حتی استفادهکنندگان عادی، به سمت گزینههای جایگزین سوق پیدا کردهاند. مدلهای ارائهشده توسط گوگل و همچنین پروژه متعلق به ایلان ماسک، با وعده آزادی عمل بیشتر و پاسخگویی منعطفتر، توانستهاند توجه این گروهها را جلب کنند. کاربران میگویند این پلتفرمها تعادل واقعبینانهتری میان ملاحظات ایمنی و نیازهای عملی برقرار کردهاند.این مدلها تلاش کردهاند بهجای مسدودسازی گسترده، بر تشخیص دقیقتر زمینه و نیت کاربر تمرکز کنند. نتیجه این سیاست، تجربهای روانتر و کارآمدتر برای کاربر بوده است؛ تجربهای که در آن، ایمنی حفظ میشود اما خلاقیت و تحلیل قربانی نمیشوند.

از سوی دیگر، مدلهای متنباز نیز در این شرایط بیش از گذشته مورد توجه قرار گرفتهاند. نبود ساختارهای سختگیرانه و امکان بررسی و تغییر کد، باعث شده این مدلها به گزینهای جذاب برای کسانی تبدیل شوند که از فضای بسته و محدود خسته شدهاند. برخی تحلیلگران معتقدند استقبال از این مدلها، واکنشی مستقیم به سیاستهای کنترلی شدید در پلتفرمهای انحصاری است.

کارشناسان صنعت هوش مصنوعی هشدار میدهند که ادامه این مسیر میتواند به تضعیف جایگاه OpenAI در میان کاربران پیشرفته منجر شود. در بازاری که سرعت، دقت و آزادی عمل نقش تعیینکننده دارند، محدودسازی بیش از حد نهتنها مزیت رقابتی ایجاد نمیکند، بلکه کاربران را به سمت گزینههای دیگر سوق میدهد. آنها تأکید میکنند که امنیت زمانی مؤثر است که هوشمندانه و متناسب اعمال شود، نه بهعنوان ابزاری برای خاموشکردن هر نوع تعامل پیچیده.

در مجموع، آنچه از این تحولات برمیآید، شکلگیری یک شکاف جدی میان سیاستهای کنترلی OpenAI و انتظارات کاربران است. اگر این شرکت نتواند تعادلی واقعی میان مسئولیتپذیری و کارآمدی برقرار کند، احتمالاً شاهد ادامه روند خروج کاربران و تقویت جایگاه رقبایی خواهد بود که سانسور را جایگزین مدیریت آگاهانه نکردهاند.